Les deepfakes, ou hypertrucages, sont des informations mensongères ou délibérément biaisées qui se présentent sous la forme d’un contenu falsifié grâce à l’utilisation de logiciels dits « d’apprentissage profond » d’intelligence artificielle, d’où le mélange des termes « deep-learning » et « fake content ». Initialement créés dans le domaine cinématographique pour des besoins de doublage, ces « infox » sont utilisées tant pour donner vie à La Joconde dans les musées, que pour insérer le visage d’actrices connues sur un contenu pornographique, pour faire prononcer des abominations à des personnalités publiques et/ou politiques, que pour modifier les frontières de notre monde.

Le deepfake, ce procédé accessible aux enjeux considérablement inquiétants

Les deepfakes ne seraient rien sans le réseau antagoniste génératif (GAN), composé d’un système d’algorithmes dit « générateur » de nouvelles données, chargé de créer du contenu pertinent, et d’un autre système d’algorithmes dit « discriminateur », qui va déterminer si le contenu obtenu est ou non pertinent et réaliste. Le procédé de GAN permettrait aux algorithmes d’apprendre d’eux-mêmes, sans intervention humaine, afin de produire un deepfake de haute qualité.

L’accessibilité de la création d’un deepfake est surprenante : il suffit d’être équipé d’un bon logiciel, d’un ordinateur ayant une capacité de stockage suffisante et d’un peu de patience. De nombreux logiciels de deepfake, comme l’application Zao, sont disponibles en ligne gratuitement. Des journalistes du Monde ont réussi à réaliser un deepfake réaliste en se basant sur deux vidéos HD de Jean Dujardin et Emmanuel Macron, analysées par le logiciel qui extrait toutes les images relatives au visage de l’acteur, en décomposant toutes les expressions trouvées, afin d’y plaquer avec précision celui du président de la République.

Le phénomène du deepfake, même s’il reste utilisé dans 95% des cas dans le domaine pornographique, se politise au point de rendre dubitatif le public quant à la vérification du caractère mensonger du contenu visionné. On peut prendre l’exemple de son invocation en France dans le procès Dieudonné, mais également la réalisation d’une infox vidéo représentant l’ambassadeur du Cameroun tenant des propos colonisateurs à l’égard de l’Etat.

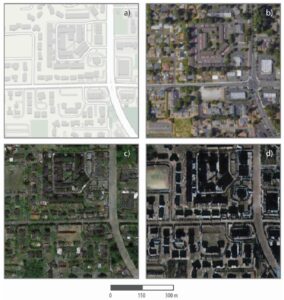

Les deepfakes pourraient également changer nos certitudes quant à notre rapport au monde. Todd Myers, directeur des systèmes d’information au sein de l’Agence nationale de renseignement géospatiale de l’armée américaine, s’inquiétait de la capacité de l’utilisation des GAN dans la création de fausses images satellites réalistes. Le professeur associé en sciences de l’information géographique à l’université de Washington, Bo Zhao, a pu démontrer, en réalisant un deepfake satellite de Tacoma (Washington) à l’aide de son équipe de géographes, que l’inquiétude était avérée. Tout comme l’hypertrucage d’Emmanuel Macron en Jean Dujardin, les chercheurs ont fourni une quantité considérable d’images de cartes correspondant d’une part à la ville de Seattle, de l’autre à la ville de Pékin afin de les insérer dans le cadre satellite initial de Tacoma. Ils laissèrent quelque temps le générateur proposer des résultats qu’analysait le discriminateur avant d’obtenir un hypertrucage indétectable à l’œil nu. Le deepfake peut donc faire réellement son entrer dans notre quotidien, même s’il est pour le moment impossible d’affirmer si de tels contenus ont déjà été diffusés.

Les enjeux des deepfakes pornographiques semblent évidents (atteinte à la dignité de la personne, atteinte au Droit à l’image pour ne pas être exhaustif), tout comme les répercussions que peuvent avoir les deepfakes politiques dans le champ socio-politique et le débat public (la confusion des citoyens dans la confiance du gouvernement est évidemment dupliquée en dehors des Etats démocratiques), notamment lorsque ces contenus susceptibles de passer pour véridiques sont largement diffusés sur des réseaux sociaux.

Concernant les deepfakes géographiques, les conséquences économiques peuvent s’avérer concrètes, comme la nécessité de réactualiser les carte GPS des voitures qui auraient – selon l’inquiétude de Todd Myers – un coût économique considérable, ou encore l’augmentation des risques d’accidents de circulation en cas de GPS annonçant une ligne droite en lieu et place d’un virage. On pourrait compter sur la vigilance des automobilistes, mais rappelons simplement que certains obéissent aveuglément à leur application GPS jusqu’à réaliser de dangereux demi-tours sur les autoroutes…

Les conséquences de deepfakes satellites pourraient également avoir des répercussions géopolitiques considérables. La carte est un outil permettant à un Etat de connaître la situation géographique d’un autre, intérêt ultime en cas de guerre que certains, comme la Chine, protègent profondément à l’aide des nouvelles technologies brouillant les pistes. La carte peut également être analysée à des fins de dénonciation de crimes contre l’humanité ou de recherches scientifiques. Pour illustrer les conséquences géopolitiques d’un deepfake satellite, il suffit d’imaginer Donald Trump, niant l’existence du réchauffement climatique via ces « preuves » irréfragables face à un autre politique armé d’une carte démontrant les conséquences actuelles de ce phénomène. Ces infox indétectables pourraient rendre confuses nos conceptions des frontières existantes, et faire renaître des questions anciennes comme « La Terre est-elle vraiment ronde ? ». De quoi enjouer les platistes et autres complotistes créatifs, tout en inquiétant les communautés averties, s’interrogeant sur la qualité de l’encadrement de telles pratiques.

Le double rôle de l’IA, ennemie et alliée du Droit

Le rapport conjoint du CAPS (Centre d’analyse, de prévision et de stratégie du ministère de l’Europe et des Affaires étrangères) et l’IRSEM (Institut de recherche stratégique de l’École militaire du ministère des Armées) « Manipulations de l’information » réalisé en 2018 affirme que « ces tendances vont participer d’une atomisation extrême de l’information, avec la disparition ou la fragilisation des acteurs pouvant servir de “tiers de confiance” ».

Les deepfakes peuvent être considérés comme encadrés par la loi de 1881 sur la liberté de presse sanctionnant dans son article 27 « la diffusion ou reproduction, par quelque moyen que ce soit, de nouvelles fausses, de pièces fabriquées, falsifiées ou mensongèrement attribuées à des tiers lorsque, faite de mauvaise foi, elle aura troublé la paix publique, ou aura été susceptible de la troubler », par la LCEN dans son article 6. Les deepfakes personnifiés peuvent être qualifiés d’usurpation d’identité ou d’escroquerie par l’article 313-1 du Code pénal ou encore les articles 226-1 et 226-2 du même Code sanctionnant la publication de montage de parole ou image d’une personne sans son consentement et qui auraient été manipulées ou détournées.

Caroline Janvier et Colette Mélot ont interrogé le secrétaire d’État auprès du ministre de l’Économie et des finances et du ministre de l’action et des comptes publics, chargé du numérique sur l’encadrement actuel de ces deepfakes. Selon lui, « les “hypertrucages” étant une des modalités des “infox”, la loi du 22 décembre 2018 relative à la lutte contre la manipulation de l’information fournit de premières armes pour lutter contre ce phénomène. La loi peut en effet s’adapter aux hypertrucages en ce qu’elle permet la création d’un référé spécifique pour faire stopper en urgence la diffusion des fausses informations (comprenant ainsi les deepfakes politiques) et exigeant une transparence de la part des nombreux acteurs numériques afin de divulguer l’origine des contenus sponsorisés et les demandeurs de la propagation du contenu en périodes électorales. Il convient de signaler que si la Loi de 2018 étend les pouvoirs du CSA, fusionnant avec l’HADOPI pour devenir récemment l’Autorité de régulation de la communication audiovisuelle et numérique, elle instaurait également une obligation de coopération de la part des plateformes et entreprises de presse dans « la lutte contre la diffusion de fausses informations ». La notion de « fausse information » avait fait par ailleurs débat lors de la rédaction de la loi de 2018 avant d’être définie comme une « allégation ou imputation inexacte ou trompeuse d’un fait de nature à altérer la sincérité du scrutin, diffusée de manière délibérée, artificielle ou automatisée et massive par le biais d’un service de communication au public en ligne. »

De nombreux projets élaborés par des entreprises de presse comme « InVid » (Association France Presse), « Vrai ou frake » (Franceinfo), ou encore « Décodex » (Le Monde). De leur côté, les plateformes luttent également contre ces hypertrucages, comme Facebook ayant lancé le « Deepfake Challenge » avec le PAI. En créant le Partnership On AI (PAI), Amazon, Facebook, Google, Microsoft, Twitter, les grands noms de la numérisation du monde travaillent, en prônant les efforts collectifs, sur la sécurisation de l’intelligence artificielle mais également sur la question du deepfake.

Certains partis, comme Hao Li, chercheur en intelligence artificielle, estiment que la meilleure arme pour lutter contre les deepfakes malveillants serait tout simplement de savoir en créer de meilleurs. Comprendre son ennemi pour se connaître soi-même : au temps du numérique, Sun Tzu aurait sans aucun doute soutenu cette démarche dans cette lutte (la lutte actuelle, pour éviter la répétition de « cette ») contre la diffusion de fausse information.

La sensibilisation du public : comment éviter une crise de confiance ?

Le développement de projet de lutte par le Droit, les entreprises de presse, les plateformes, les chercheurs spécialisés dans l’intelligence artificielle doit inéluctablement être le complément d’une campagne de sensibilisation du public. Seulement, la correction des informations fausses diffusées par un deepfake pourrait s’avérer plus complexe que l’on ne le croit, le neuroscientifique Roberto Cabeza affirmant même que notre mémoire est susceptible d’intégrer de faux souvenirs de manière irréversible.

Afin d’éviter une crise de la confiance, la solution de la création de certifications, de label ou mention du caractère manipulé des contenus pourrait s’avérer intéressante ; on peut par ailleurs en trouver une liste non-exhaustive sur le site du PAI.

La question du développement de labels pour garantir l’authenticité du contenu est cependant discutable dans la mesure où certains acteurs dominants pourraient déterminer les nouveaux critères du vrai et ainsi établir un « droit à la vérité » dont les motivations pourraient ne pas correspondre au modèle imposé par l’article 10 de la CEDH.

SOURCES :

DELAUNAY (A.), Deepfakes géographiques : l’intelligence artificielle menace-t-elle la crédibilité de l’imagerie satellite ?, Le Monde PIXELS, 13 octobre 2021.

Loi nº 2018-1202 du 22 décembre 2018 relative à la lutte contre la manipulation de l’information, JO 23 décembre 2018.

Assemblée Nationale. Question nº 16587, du 05 février 2019. Numérique, JOAN 15 octobre 2019.

Sénat. Question nº 11327, du 04 juillet 2019. « Deepfakes », JO Sénat 11 Juin 2020, p. 2703

Communauté européenne, Livre blanc « Intelligence artificielle. Une approche européenne axée sur l’excellence et la confiance », 19 février 2020.

Règlement (UE) numéro 2016/679 du 27 avril 2016 relatif à la protection des personnes physiques à l’égard du traitement des données à caractère personnel et à la libre circulation de ces données, et abrogeant la directive 95/46/CE, dit Règlement Général sur la Protection des Données (RGPD).

Résolution du Parlement européen n° 2020/2015 (INL) du 20 octobre 2020 sur les droits de propriété intellectuelle pour le développement des technologies liées à l’intelligence artificielle.

Rapport conjoint CAPS / IRSEM, Ministère des Armées, 4 septembre 2018, 214p.

Comparison of Digital Globe 17 July Satellite Imagery with Russian Ministry of Defense 17 July Satellite Imagery, Bell¿ngcat Investigation, 31 mai 2015, 20p.

De Bellescize D., Fake news : une loi polémique, qui pose plus de questions qu’elle n’en résout, Constitutions 2018, p. 559

Dreyer E., Fausse bonne nouvelle : la loi du 22 décembre 2018 relative à la manipulation de l’information est parue, Legipresse 2019, nº 367, p. 19

LANGLAIS-FONTAINE (C.), Démêler le vrai du faux : étude de la capacité du droit actuel à lutter contre les deepfakes, Revue des droits de l’homme, n°18, 17p.

Le Monde avec AFP, Dieudonné condamné à quatre mois de prison et 15 000 euros d’amende dans trois affaires distinctes, Le Monde, 2 juillet 2021

Maffre-Baugé A., Deepfakes : faut-il légiférer ?, in Actualité du droit des technologies nouvelles (octobre 2019 – février 2020), RLDC 2020/181, nº 6786.

Quéméner M., Fake news, infox, quelles réponses juridiques ?, D. IP/IT 2019, p. 178.

Rambaud R., Lutter contre la manipulation de l’information, AJDA 2019, p. 453.

TUAL (M.) :

On a essayé de fabriquer un deepfake (et on est passé à autre chose), Le Monde PIXELS, 12 octobre 2021.

A peine lancée, l’application de vidéos « deepfake » Zao suscite des inquiétudes, Le Monde PIXELS, 3 septembre 2019.

Du porno aux fausses informations, l’intelligence artificielle manipule désormais la vidéo, Le Monde PIXELS, 4 février 2018.

TUCKER (P.), The Newest AI-Enabled Weapon: ‘Deep-Faking’ Photos of the Earth, Defense One, 31 mars 2019.

Vocabulaire de la culture : édition, médias et mode (liste de termes, expressions et définitions adoptés), Commission d’enrichissement de la langue française, JO 23.05.2020.