A l’ère du tout numérique, quand le quidam devient un « homo-numéricus », les sphères de communication se multiplient sur internet.

Au-delà des réseaux sociaux, des plateformes se créent pour réunir des personnes autour de passions communes. Pour les amateurs de jeux-vidéos, Twitch est la référence en la matière.

Des simples joueurs deviennent des stars et proposent à leurs fans des rendez-vous quotidiens dans lesquels ces derniers ont l’occasion de communiquer au travers d’un tchat de discussion.Dans ce tiers-lieu, il existe un arbitre, ici ce sont des modérateurs, choisis par le vidéaste et streamer, ils veillent à la régulation des discussions.

Mais comme toujours, des comportements néfastes existent, récemment, la parole s’est ouverte sur les phénomènes de cyber-harcèlement que vivent certains créateurs de contenus.

Le « Suspicious User Detection », est la réponse de Twitch face à cette problématique, un nouvel outil de modération basé sur l’intelligence artificielle.

I. La problématique du Cyber-harcèlement sur Twitch.

Qu’est ce que Twitch ?

Afin de répondre à la problématique relative à l’actualité traitée, il est nécessaire dans un premier temps de définir ce qu’est Twitch. Si elle peut sembler éloignée des réseaux sociaux traditionnels classiques comme Facebook ou Instagram, cette plateforme de communication détient une place importante dans le paysage de l’internet mondial que l’on soit un fan de créations vidéoludiques ou non.

Twitch est un service de diffusion de vidéos en direct, si celui-ci a été créé en 2011, dès 2014 le géant Amazon rachète la plateforme.

N’importe qui peut créer une chaîne et diffuser le contenu qu’il souhaite si ce dernier n’enfreint pas les règles de la plateforme, ainsi que rejoindre le flux en direct et échanger à l’aide d’un tchat de discussion.

Si les jeux-vidéos sont l’activité phare de la plateforme, de nombreux « streamers » sont là pour discuter avec leurs fans sur une pluralités de sujets. Si un sujet intéresse un public particulier, il y aura inexorablement un individu abordant cela sur Twitch.

Ce phénomène est à prendre en compte : selon Médiamétrie c’est 5 millions de français qui se connectent mensuellement à cette plateforme et environ 1 million de français s’y rendent quotidiennement.

Des milliards d’heures de vidéos sont cumulées chaque année. Si d’un point de vue global Twitch semble être un environnement propice au partage et à la sympathie, comme dans chaque jardin d’Eden se cache une faille, la qualité première de l’Homme étant d’être imparfait. Suivant cette logique, des comportements inexorablement déviants sont à déplorer.

La récente mise en lumière de la problématique relative à Twitch.

Twitch peut être le théâtre de moments merveilleux et d’humanisme comme être le lieu de déferlement de haine et de propos des plus déplacés. Si certains commentaires isolés peuvent être rapidement masqués et ne pas venir interférer, la mode est aux véritables raids qui sont organisés pour venir déstabiliser le quotidien de certains streamers.

Face à ces cyberviolences qui se caractérisent par des attaques de masses d’individus exposant des propos racistes, misogynes ou homophobes envers les créateurs de contenus, quelles sont les solutions ?

Si Twitch avait déjà auparavant essayé de venir poser un premier égide face au cyberharcèlement, l’année 2021 nous montre qu’il n’est pas totalement opérant.

Limiter certaines expressions n’as pas suffi, chaque jour, des individus viennent anéantir l’expérience vidéoludique de certains viewers et bouleverser le quotidien de streamers.

S’il est possible de bannir un individu, celui peut rapidement créer un nouveau compte et revenir porter préjudice.

Face à cet état de fait, Twitch a alors tenté une nouvelle mesure à l’aide de l’intelligence artificielle.

II. La mise en place du “Suspicious User Detection“, un mécanisme lié au Machine Learning.

Qu’est ce que le “Machine Learning” ?

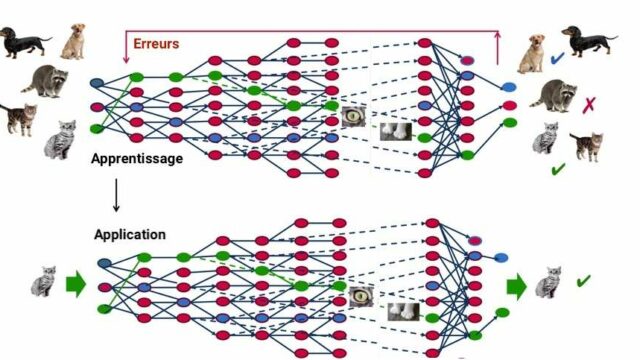

Initialement voulu pour réaliser au prisme d’algorithmes des prises de décisions comme pourrait le faire un Humain, le Machine-Learning tend à réaliser un apprentissage des plus pointus face à une pluralité de comportements.

Afin de présenter le Machine-Learning, le schéma initial serait de montrer sa compétence première dans la détection d’animaux sur des photos.

En présentant à une intelligence artificielle une pluralité de photos d’animaux différents et en associant à chaque photo des critères bien précis comme pourrait le faire un humain, celle-ci après avoir emmagasiné une multitudes d’informations pourra par la suite identifier n’importe quelle animal sur une nouvelle photo qui lui sera présentée.

Ainsi, suite à cette idée et à l’aide de cette technologie, peut-on identifier les individus a risques? peut-on identifier qui est susceptible de venir troubler le quotidien des streamers?

La mise en pratique de cette intelligence artificielle par Twitch.

Il est intéressant à présent d’observer comment fonctionne l’intelligence artificielle basée sur le Machine-Learning que Twitch est venu mettre en place.

Twitch offre la possibilité au prisme de cette IA d’identifier un individu qui chercherait à contourner un bannissement avec une double possibilité de qualification.

Cet outil signalera les comptes suspects comme une personne contournant “probablement” ou “possiblement” un bannissement. Suite à cela, l’intervention d’un modérateur sera requise.

Pour les personnes contournant “probablement” un bannissement, les messages ne seront pas du tout envoyés sur le chat. Cela dit, ils seront affichés pour les créateurs et les modérateurs afin qu’ils puissent décider de conserver la restriction, de surveiller l’utilisateur ou de le bannir de la chaîne.

Pour les personnes contournant “possiblement” un bannissement, les messages apparaîtront normalement dans le chat, mais le compte sera signalé au créateur et à ses modérateurs afin qu’ils puissent surveiller l’utilisateur et l’empêcher d’envoyer des messages sur le chat si nécessaire.

Ainsi, à l’aide de cette pratique, une tentative de règlement a priori est envisagée et non plus a posteriori comme auparavant, toutefois on peut s’interroger sur l’efficacité de cette démarche et l’impact que celle-ci peut avoir.

III. Une solution adaptée ? Quels sont les risques et enjeux d’une telle solution ?

L’efficacité de l’intelligence artificielle et ses limites.

Un des problèmes premiers à énoncer est relatif à la fonctionnalité du Machine Learning, celui-ci n’est pas parfait, Twitch le reconnait dans un de ses communiqués : « le Machine-Learning ne sera jamais à 100% efficace, ce qui signifie qu’il y a des risques de faux positifs, ou de faux négatifs ».

Si cela permettra d’endiguer certains commentaires abusifs, comment ce Machine-Learning pourra-t ’il gérer toutes les problématiques dans un phénomène de groupe ?

Par ailleurs, on peut s’interroger face à la possibilité de créer une multiplicité de compte avec une même adresse électronique. Si cet algorithme sera capable de traiter et identifier cette problématique, il reste toujours aussi facile de créer un nouveau compte et de se cacher derrière une pluralité d’adresse IP notamment avec l’effervescence et l’engouement derrière l’utilisation de VPN.

Il est nécessaire par ailleurs de prendre en considération ces mesures au prisme de la liberté d’expression, il ne doit pas y avoir non plus de politique de censure. Si on offre la possibilité de réaliser un contrôle a priori de la part du modérateur, qui est un quidam comme un autre, il est possible que celui-ci ait une subjectivité biaisée, ce qui entrainerait un frein et une forme d’ingérence dans la liberté de parole.

Peut-on imaginer alors une autre solution ? Comment peut-on trouver un équilibre entre le respect des utilisateurs, la lutte contre le cyber harcèlement et le droit de tous ?

Les possibles modifications liées aux sphères de communications sur Internet

Risque-on d’arriver vers une IA puritaine et vindicative ? Il est nécessaire de réaliser des agrégats moraux et éthiques pour ne pas en arriver à un tel point. Comment arriver à cette utopie liant liberté d’expression et respect de tous, si la mise en place de cette IA par Twitch ne semble pas être une solution pour les victimes de cyberharcèlement ? On peut s’interroger sur la volonté de mettre en place un encadrement plus important.

Cette actualité vient souligner l’importance de mettre en place des outils justes et éthiques pour protéger le quidam utilisateur. La problématique de l’intelligence artificielle semble être la pierre angulaire d’un pan du droit qu’il sera important de traiter rapidement. Au-delà de l’éducation numérique il est important de concevoir l’idée d’un règlement conciliant chaque aspect des droits fondamentaux.

A ce propos, le projet de règlement établissant des règles harmonisées concernant l’intelligence artificielle publié le 21 avril 2021 par la commission européenne est le premier pilier d’un nécessaire sanctuaire liant intelligence artificielle et droits fondamentaux, il sera alors intéressant de voir les répercussions d’un tel règlement notamment au joug des services de communications au public en ligne qui se servent déjà de telles IA dans le cadre de la modération des utilisateurs.

Sources :

“Qu’est-ce que Twitch, ce service vidéo dont tout le monde parle” écrit par Chloé Woitier publié le 11.03.2021, Le Figaro.

“5 chiffres clés pour les 10 ans de Twitch” écrit par David-Julien Rahmil publié le 09.06.2021, L’ADN.

“Le désespoir des streameurs face au harcèlement sur Twitch” écrit par Pèse sur Start avec AFP publié le 31.08.2021, Pèse sur Start.

“Twitch : face au harcèlement en ligne les streamers se mettent en grève” écrit par Louise Bernard publié le 02.09.2021, Europe 1.

“L’enfer quotidien que subissent les streameuses” Vidéo Youtube réalisé par POPCORN publié le 09.12.2021.

“Deep Learning ou Apprentissage Profond : qu’est-ce que c’est” écrit par Hossam M publié le 28.09.2020, Datascientest.

“Deep Learning : qu’est-ce que c’est” écrit par Céline Deluzarche, Futura Science.

“Lutter contre le contournement de bannissement avec le machine learning” Communiqué Twitch en date du 30.11.2021, Twitch.

“Cyberharcèlement : Twitch lance une IA pour repérer ceux qui contournent les bans” écrit par Aurore Gayte publié le 01.12.2021, Numérama.

Article 10 CEDH.